文章目录

- DeepLabV1的引入

- 1.语义分割任务中存在的问题

- 2.DeepLabV1的优势

- 3.网络结构

- 1.largeFOV

- 2.网络搭建细节

- 3.MSc(Multi-Scale)

1.语义分割任务中存在的问题

在论文的引言部分(INTRODUCTION)首先抛出了两个问题(针对语义分割任务): 1.信号下采样导致分辨率降低 2.空间“不敏感” 问题(具有不变性)

解决办法: 对于第一个问题信号下采样,作者说主要是采用Maxpooling导致的,为了解决这个问题作者引入了空洞卷积 / 膨胀卷积 / 扩张卷积

对于第二个问题空间“不敏感”,作者说分类器自身的问题(分类器本来就具备一定空间不变性),这个问题还是Maxpooling导致的。为了解决这个问题作者采用了fully-connected CRF(Conditional Random Field)方法,这个方法只在DeepLabV1-V2中使用到了,从V3之后就不去使用了,而且这个方法挺耗时的。

什么是空间不敏感性: 以获取图像中物体为核心的决策,必然需要空间不变性/不敏感。换句话说,对于同一张图片进行空间变换(如平移、旋转),其图片分类结果是不变的。 但对于图像分割等,对于一张图片进行空间变换后,其结果是改变的。

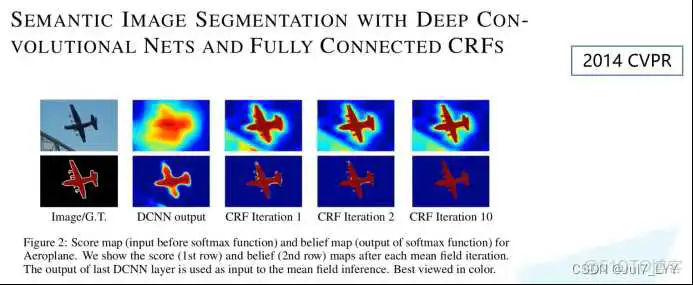

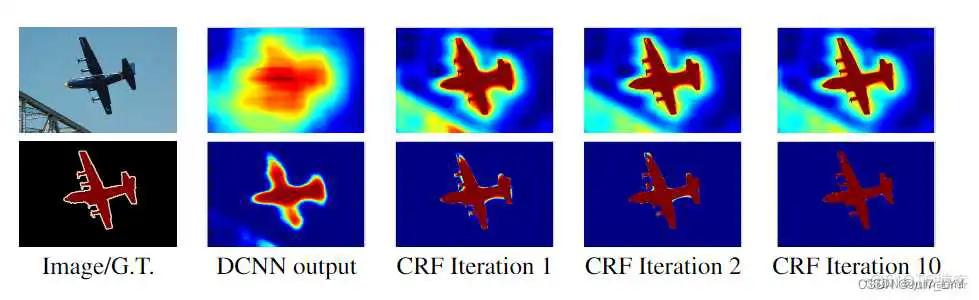

什么是全连接条件随机场(fully-connected CRF):

作者在论文中提出使用全连接条件随机场(CRF)来解决分割中不平滑的问题和修复一些小的结构。

可以很明显的看到,随着CRF迭代次数增加,对飞机的分割效果越来越好。

2.DeepLabV1的优势

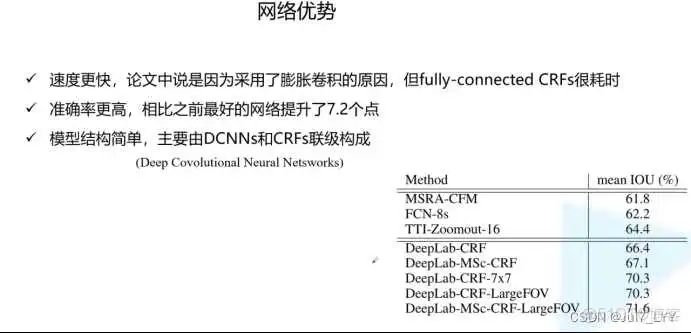

相比之前的一些网络,本文提出的网络具有以下优势:

1.速度更快,论文中说是因为采用了膨胀卷积的原因,但fully-connected CRF很耗时

2.准确率更高,相比之前最好的网络提升了7.2个点

3.模型很简单,主要由DCNN和CRF联级构成

3.网络结构

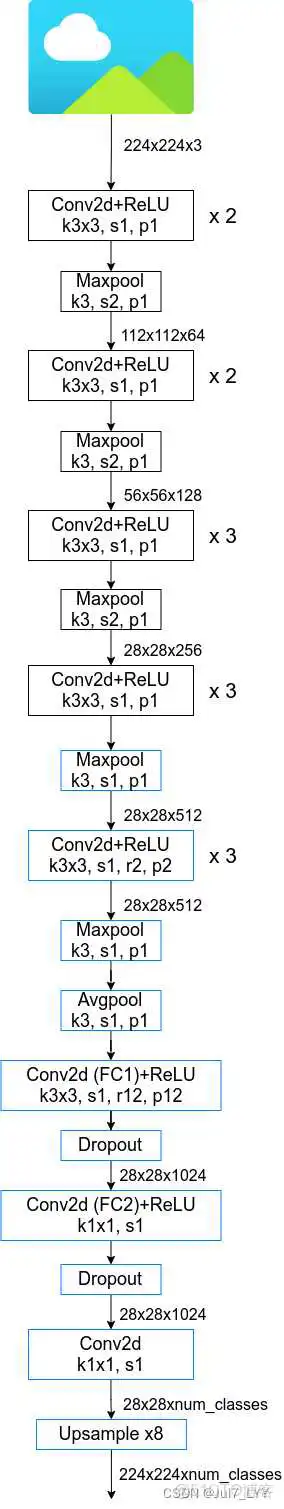

Deeplab由三个模块组成:多尺度+CRF+largeFOV

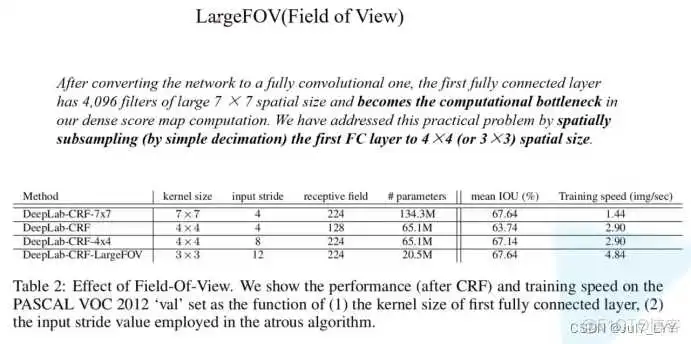

1.largeFOV

largeFOV的作用:在保证mean IOU不变的情况下,减小参数的数量和加速训练的速度

最后一个不光将kernelsize下采样到33,并且把卷积核的个数也由4096下采样到1024。包括第二个卷积层也从下降到11*1024。

第一行DeepLab-CRF-7x7就是直接将FC1按照FCN论文中的方法转换成7x7大小的卷积层,并且膨胀因子r=4(receptive field=224)。

第二行DeepLab-CRF是将7x7下采样到4x4大小的卷积层,同样膨胀因子r=4(receptive field=128),可以看到参数减半,训练速度翻倍,但mean IOU下降了约4个点。

第三行DeepLab-CRF-4x4,是在DeepLab-CRF的基础上把膨胀因子r改成了8(receptive field=224),mean IOU又提升了回去了。

第四行DeepLab-CRF-LargeFOV,是将7x7下采样到3x3大小的卷积层,膨胀因子r=12(receptive field=224),相比DeepLab-CRF-7x7,参数减少了6倍,训练速度提升了3倍多,mean IOU不变。

2.网络搭建细节

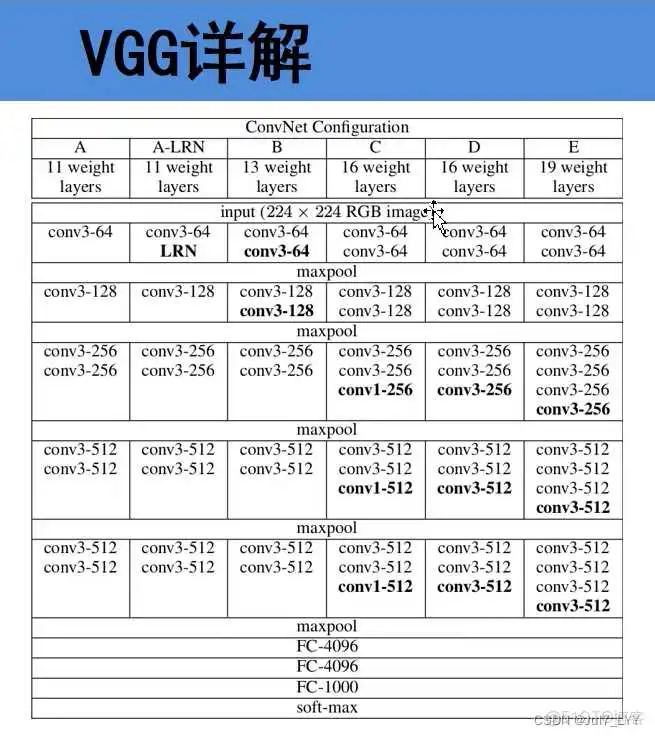

网络的backbone是VGG-16,并且和FCN网络一样将全连接层的权重转成了卷积层的权重,构成全卷积网络。

VGG-16作出的变化:(对比下图VGG-16【D】的架构)

1.VGG论文中是kernel=2,stride=2,但在DeepLabV1中是kernel=3,stride=2,padding=1。

2.接着就是最后两个Maxpool层的stride全部设置成1了(这样下采样的倍率就从32变成了8)。

3.最后三个3x3的卷积层采用了膨胀卷积,膨胀系数r=2。

4.两个全连接层全部换成卷积层,将kernelsize下采样到3×3,并且把卷积核的个数也由4096下采样到1024。包括第二个卷积层也从1×1×4096下降到1×1×1024。(这样不仅可以减少参数还可以减少计算量)

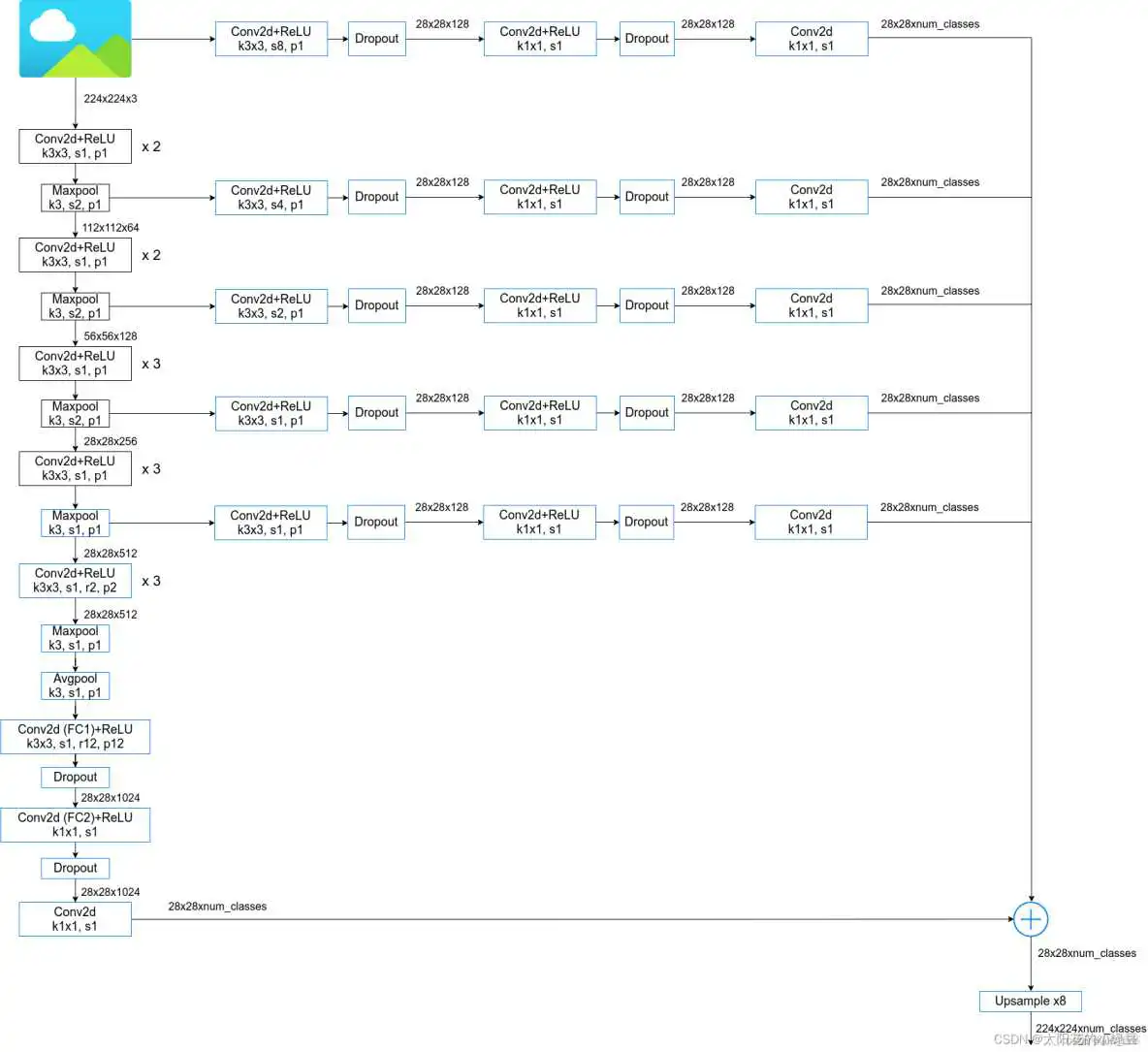

3.MSc(Multi-Scale)

Multi-Scale Prediction,即融合多个特征层的输出。除了使用之前主分支上输出外,还融合了来自原图尺度以及前四个Maxpool层的输出,更详细的结构参考下图。论文中说使用MSc大概能提升1.5个点,使用fully-connected CRF大概能提升4个点。但在源码中作者建议使用的是不带MSc的版本,以及看github上的一些开源实现都没有使用MSc。MSc不仅费时而且很吃显存。

到此这篇resnet50比34效果差(resnet50和18)的文章就介绍到这了,更多相关内容请继续浏览下面的相关推荐文章,希望大家都能在编程的领域有一番成就!

版权声明:

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若内容造成侵权、违法违规、事实不符,请将相关资料发送至xkadmin@xkablog.com进行投诉反馈,一经查实,立即处理!

转载请注明出处,原文链接:https://www.xkablog.com/rfx/44114.html