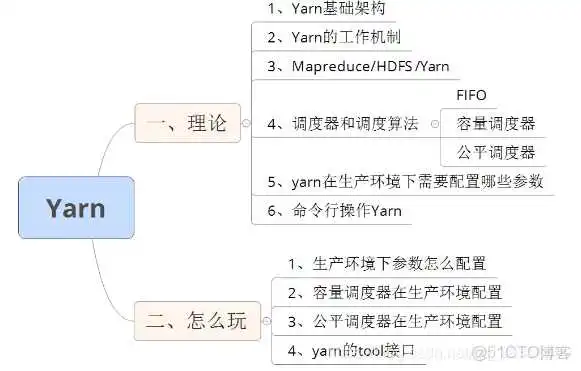

目录

1.1 Yarn基础架构

1.2 Yarn工作机制

1.3 作业提交全过程

1.4 Yarn调度器和调度算法

1.4.1 先进先出调度器(FIFO)

1.4.2 容量调度器(Capacity Scheduler)

1.4.3 公平调度器(Fair Scheduler)

1.5 Yarn常用命令

1.5.1 yarn application 查看任务

1.5.2 yarn logs 查看日志

1.5.3 yarn applicationattempt 查看尝试运行的任务

1.5.4 yarn container 查看容器

1.5.5 yarn node 查看节点状态

1.5.6 yarn rmadmin 更新配置

1.5.7 yarn queue 查看队列

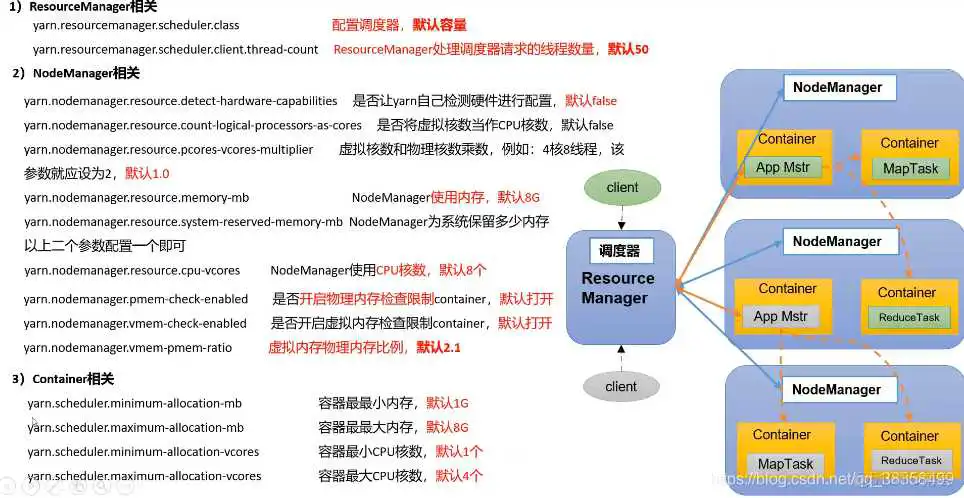

1.6 Yarn生产环境核心参数

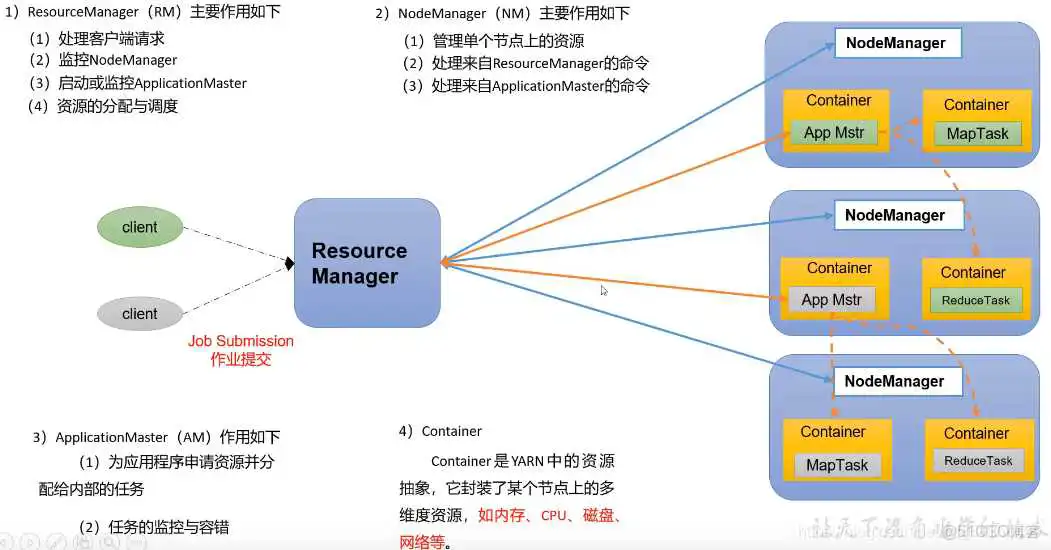

Yarn 是一个资源调度平台,负责为运算程序提供服务器运算资源,相当于一个分布式

的操作系统平台,而 MapReduce 等运算程序则相当于运行于操作系统之上的应用程序。管理集群资源,给任务合理分配资源。

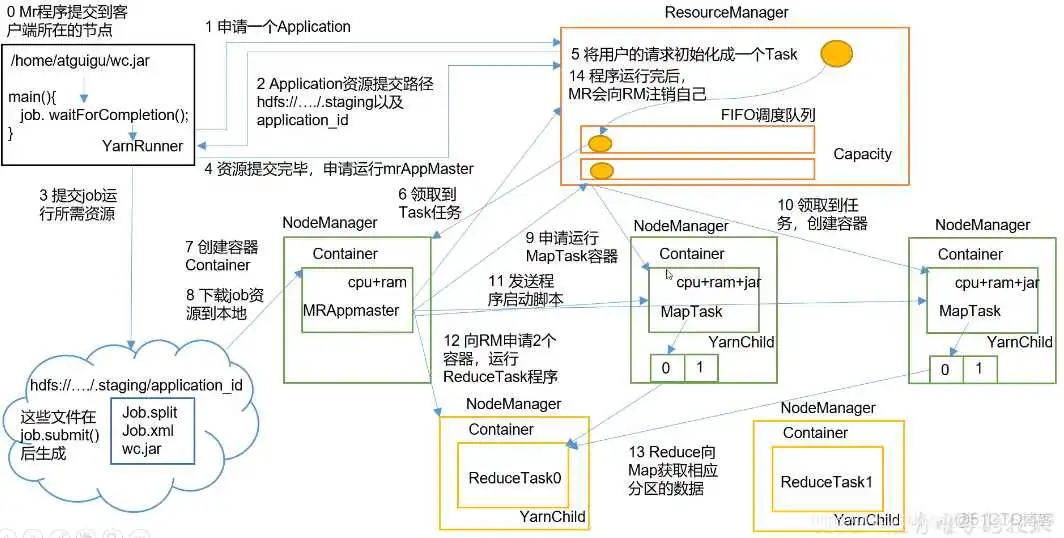

- MR 程序提交到客户端所在的节点。

- YarnRunner 向 ResourceManager 申请一个 Application。

- RM 将该应用程序的资源路径返回给 YarnRunner。

- 该程序将运行所需资源提交到 HDFS 上。

- 程序资源提交完毕后,申请运行 mrAppMaster。

- RM 将用户的请求初始化成一个 Task。

- 其中一个 NodeManager 领取到 Task 任务。

- 该 NodeManager 创建容器 Container,并产生 MRAppmaster。

- Container 从 HDFS 上拷贝资源到本地。

- MRAppmaster 向 RM 申请运行 MapTask 资源。

- RM 将运行 MapTask 任务分配给另外两个 NodeManager,另两个 NodeManager 分别领取任务并创建容器。

- MR 向两个接收到任务的 NodeManager 发送程序启动脚本,这两个 NodeManager分别启动 MapTask,MapTask 对数据分区排序。

- MrAppMaster等待所有MapTask运行完毕后,向RM申请容器,运行ReduceTask。

- ReduceTask 向 MapTask 获取相应分区的数据。

- 程序运行完毕后,MR 会向 RM 申请注销自己。

(1)作业提交

第 1 步:Client 调用 job.waitForCompletion 方法,向整个集群提交 MapReduce 作业。

第 2 步:Client 向 RM 申请一个作业 id。

第 3 步:RM 给 Client 返回该 job 资源的提交路径和作业 id。

第 4 步:Client 提交 jar 包、切片信息和配置文件到指定的资源提交路径。

第 5 步:Client 提交完资源后,向 RM 申请运行 MrAppMaster。

(2)作业初始化

第 6 步:当 RM 收到 Client 的请求后,将该 job 添加到容量调度器中。

第 7 步:某一个空闲的 NM 领取到该 Job。

第 8 步:该 NM 创建 Container,并产生 MRAppmaster。

第 9 步:下载 Client 提交的资源到本地。

(3)任务分配

第 10 步:MrAppMaster 向 RM 申请运行多个 MapTask 任务资源。

第 11 步:RM 将运行 MapTask 任务分配给另外两个 NodeManager,另两个 NodeManager

分别领取任务并创建容器。

(4)任务运行

第 12 步:MR 向两个接收到任务的 NodeManager 发送程序启动脚本,这两个

NodeManager 分别启动 MapTask,MapTask 对数据分区排序。

第13步:MrAppMaster等待所有MapTask运行完毕后,向RM申请容器,运行ReduceTask。

第 14 步:ReduceTask 向 MapTask 获取相应分区的数据。

第 15 步:程序运行完毕后,MR 会向 RM 申请注销自己。

(5)进度和状态更新

YARN 中的任务将其进度和状态(包括 counter)返回给应用管理器, 客户端每秒(通过

mapreduce.client.progressmonitor.pollinterval 设置)向应用管理器请求进度更新, 展示给用户。

(6)作业完成

除了向应用管理器请求作业进度外, 客户端每 5 秒都会通过调用 waitForCompletion()来

检查作业是否完成。时间间隔可以通过 mapreduce.client.completion.pollinterval 来设置。作业

完成之后, 应用管理器和 Container 会清理工作状态。作业的信息会被作业历史服务器存储

以备之后用户核查。

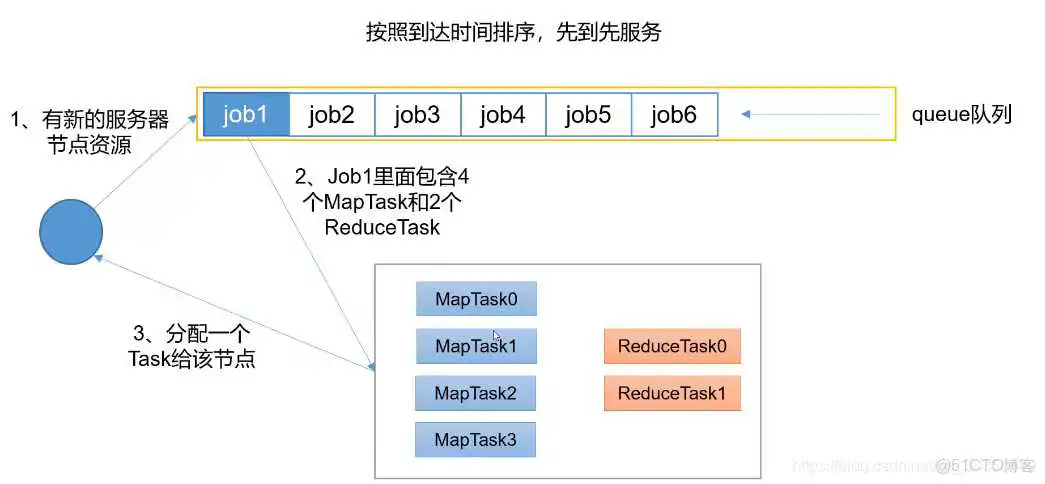

1.4.1 先进先出调度器(FIFO)

FIFO 调度器(First In First Out):单队列,根据提交作业的先后顺序,先来先服务。

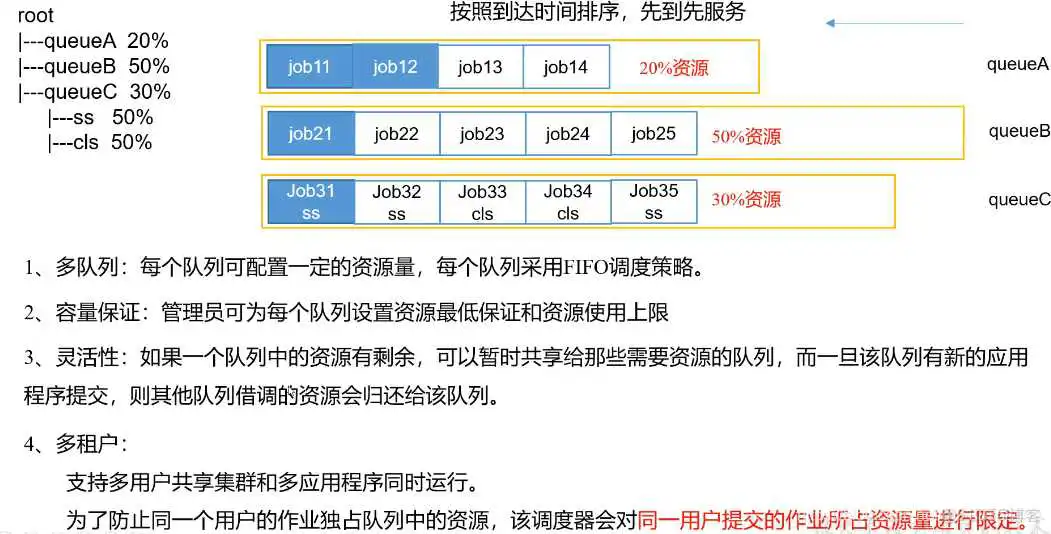

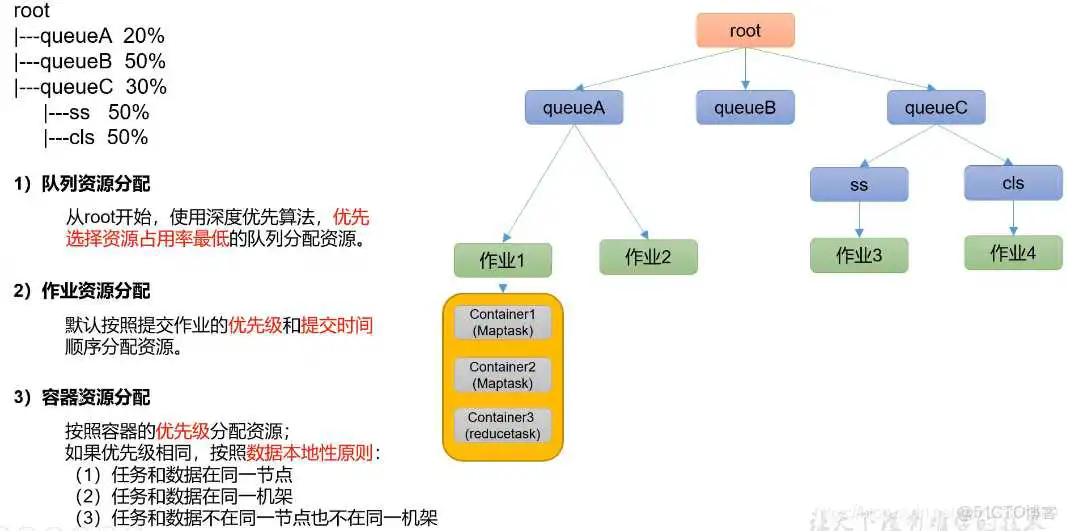

1.4.2 容量调度器(Capacity Scheduler)

Capacity Scheduler 是 Yahoo 开发的多用户调度器。

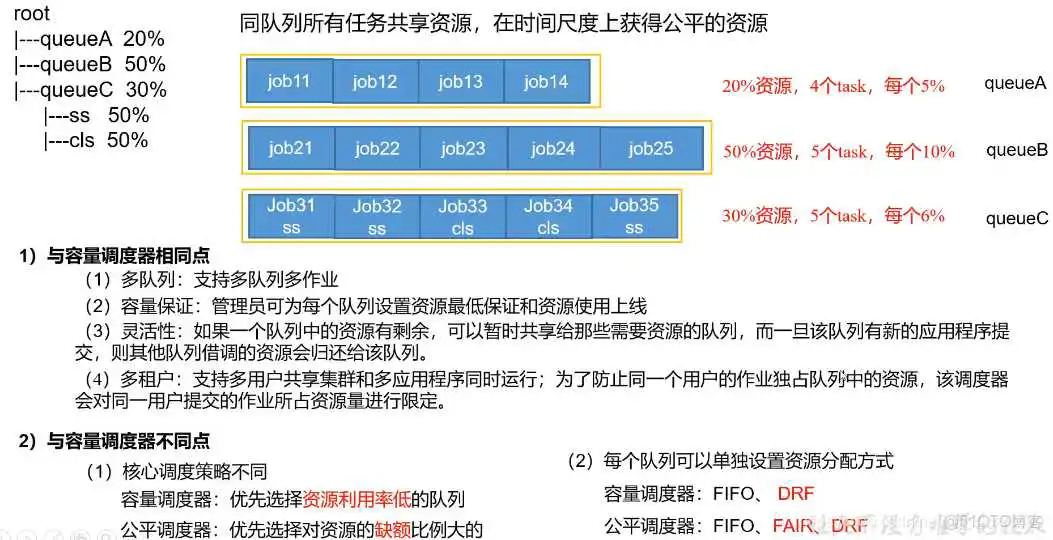

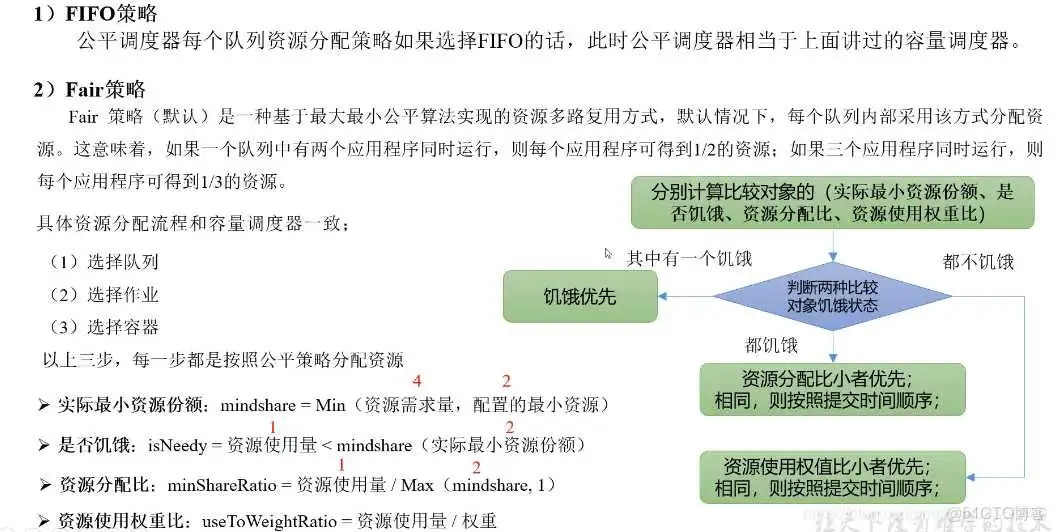

1.4.3 公平调度器(Fair Scheduler)

Fair Schedulere 是 Facebook 开发的多用户调度器。

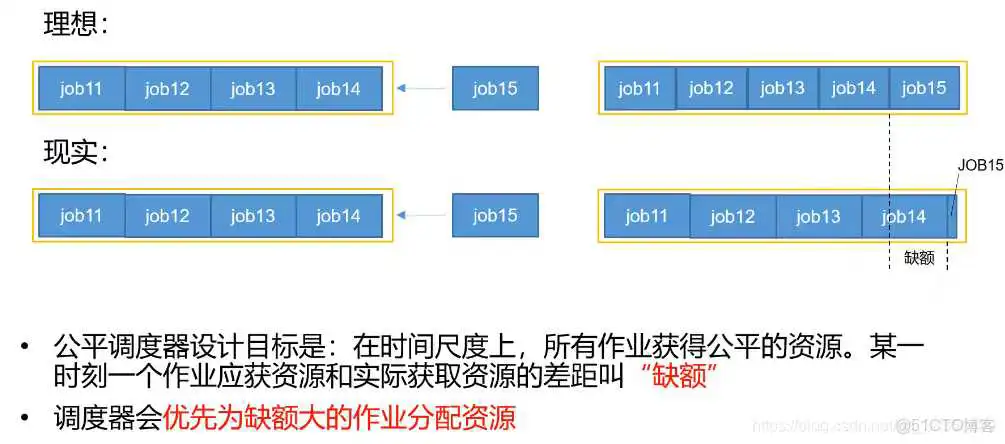

- 公平调度器特点

- 公平调度器——缺额

- 公平调度器队列资源分配方式

- 公平调度器队列资源分配算法

- 公平调度器队列资源分配方式

3 )DRF 策略

DRF(Dominant Resource Fairness),我们之前说的资源,都是单一标准,例如只考虑内存(也是Yarn默认的情况)。但是很多时候我们资源有很多种,例如内存,CPU,网络带宽等,这样我们很难衡量两个应用应该分配的资源比例。

那么在YARN中,我们用DRF来决定如何调度:

假设集群一共有100 CPU和10T 内存,而应用A需要(2 CPU, 300GB),应用B需要(6 CPU,100GB)。则两个应用分别需要A(2%CPU, 3%内存)和B(6%CPU, 1%内存)的资源,这就意味着A是内存主导的,B是CPU主导的,针对这种情况,我们可以选择DRF策略对不同应用进行不同资源(CPU和内存)的一个不同比例的限制。

1.5.1 yarn application 查看任务

- 列出所有application: yarn application -list

- 根据 Application 状态过滤:yarn application -list -appStates (所有状态:ALL、NEW、

NEW_SAVING、SUBMITTED、ACCEPTED、RUNNING、FINISHED、FAILED、KILLED):yarn application -list -appStates FINISHED - Kill 掉 Application:yarn application -kill application_95_0001

1.5.2 yarn logs 查看日志

- 查询 Application 日志:yarn logs -applicationId <ApplicationId>。例如:yarn logs -applicationId application_95_0001

- 查询 Container 日志: yarn logs -applicationId <ApplicationId> -containerId <ContainerId>。例如:yarn logs -applicationId application_95_0001 -containerId container_95_0001_01_000001

1.5.3 yarn applicationattempt 查看尝试运行的任务

- 列出所有 Application 尝试的列表:yarn applicationattempt -list <ApplicationId>。例如:yarn applicationattempt -list application_95_0001

- 打印 ApplicationAttemp 状态:yarn applicationattempt -status <ApplicationAttemptId>。例如:yarn applicationattempt -status appattempt_95_0001_000001

1.5.4 yarn container 查看容器

- 列出所有 Container:yarn container -list <ApplicationAttemptId>。例如:yarn container -list appattempt_95_0001_000001

- 打印 Container 状态: yarn container -status <ContainerId>。例如:yarn container -status container_95_0001_01_000001

注:只有在任务跑的途中才能看到 container 的状态

1.5.5 yarn node 查看节点状态

列出所有节点:yarn node -list -all

1.5.6 yarn rmadmin 更新配置

加载队列配置:yarn rmadmin -refreshQueues,动态修改,不用重启hadoop

1.5.7 yarn queue 查看队列

打印队列信息:yarn queue -status <QueueName>。例如:yarn queue -status default

版权声明:

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若内容造成侵权、违法违规、事实不符,请将相关资料发送至xkadmin@xkablog.com进行投诉反馈,一经查实,立即处理!

转载请注明出处,原文链接:https://www.xkablog.com/rfx/33236.html