官方文档介绍

https://pytorch.org/docs/master/nn.html#convolution-layers

pytorch 中文文档:

https://pytorch-cn.readthedocs.io/zh/latest/

https://pytorch.org/docs/master/generated/torch.nn.Conv1d.html#torch.nn.Conv1d

在由多个输入平面组成的输入信号上应用一维卷积。

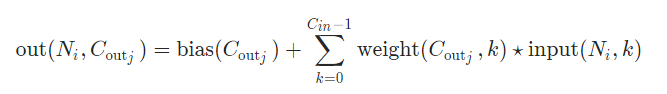

在最简单的情况下,具有输入大小的图层的输出值 ![]() 和输出

和输出 ![]() 可以精确地描述为:

可以精确地描述为:

-

在⋆ 是有效的运算符, N是一个批处理大小,C表示多个通道, L 是信号序列的长度。该模块支持。

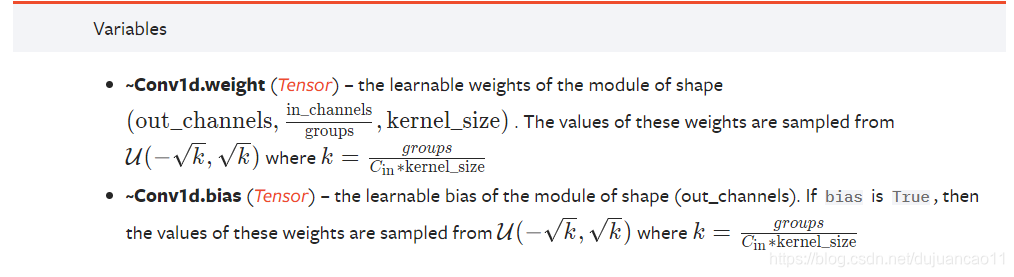

当groups = in_channels和out_channels == K * in_channels时,其中K为正整数,此操作也称为“深度卷积”。

换句话说,对于大小的输入 ![]() ,可以使用参数执行 深度乘数K的深度卷积

,可以使用参数执行 深度乘数K的深度卷积![]()

在某些情况下,当在CUDA设备上使用张量时,此运算符可能会选择不确定的算法来提高性能。如果不希望这样做,可以尝试通过设置确定操作(可能以性能为代价)。

https://pytorch.org/docs/master/notes/randomness.html

重现性

在PyTorch发行版,单独的提交或不同的平台上,不能保证完全可重复的结果。此外,即使使用相同的种子,结果在CPU和GPU执行之间也可能无法重现。

但是,您可以采取一些步骤来限制特定平台,设备和PyTorch版本的不确定行为的来源。首先,您可以控制可能导致应用程序的多个执行行为不同的随机性源。其次,您可以配置PyTorch以避免对某些操作使用不确定的算法,这样,在给定相同输入的情况下,对这些操作的多次调用将产生相同的结果。

警告

确定性操作通常比非确定性操作慢,因此对于您的模型,单次运行性能可能会降低。但是,确定性可以通过促进实验,调试和回归测试来节省开发时间。

N是一个批处理大小,C表示多个通道, L 是信号序列的长度

到此这篇conv1d函数(conv1d函数输入数据举例)的文章就介绍到这了,更多相关内容请继续浏览下面的相关推荐文章,希望大家都能在编程的领域有一番成就!

版权声明:

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若内容造成侵权、违法违规、事实不符,请将相关资料发送至xkadmin@xkablog.com进行投诉反馈,一经查实,立即处理!

转载请注明出处,原文链接:https://www.xkablog.com/sjkxydsj/20664.html

).

).