基金项目:2022年度国家重点研发计划项目“互联网教育应用的行为感知与风险监测关键技术研究”(2022YFC);2022年度国家自然科学基金面上项目“基于领域适应算法的人机协作学习能力泛化关键技术研究”()。

引用:童莉莉,曾佳,底颖(2024). AIGC视域下数字教育产品的四维风险矩阵与治理框架[J].现代远程教育研究,36(2):12-19.

摘要:数字教育是数字中国的重要组成部分。随着生成式人工智能在教育领域的快速深入应用,数字教育产品已从教育APP、小程序、云平台等成熟形态迅速衍生出大模型、虚拟机器人等创新形态。AIGC在为教育提供便捷的家校社联系、多语种的流畅交互、高效率的阅读批改等技术红利的同时,仍然面临资源质量良莠不齐、信息无序扩散、算法设计与人的认知发展弱关联等挑战。为此,亟需从社会定义范式和行为计算范式的双重视角来构建一种贯通“数字资源—信息传播—算法设计—认知评估”的四维风险矩阵,以定性和定量分析AIGC教育应用的潜在风险。同时亦需从“监管者—开发者—使用者”的主体协同视角构建治理框架,通过行业应用准入审查和服务集群常态化测评的路径来输出决策支持和治理建议。该四维风险矩阵和治理架构可为政府监管者、家校使用者和产品开发者推进AIGC良性应用生态提供重要参考。

关键词:生成式人工智能;数字教育产品;风险矩阵;教育治理

一、数字教育产品的新趋势与新挑战

2023年2月13日,第一届世界数字教育大会在北京开幕,大会以“数字变革与教育未来”为主题,首次对“数字教育”的内涵、发展目标和路径做了系统性阐述。数字教育正是在数字技术与教育深度融合的背景下产生的,其发展目标涵盖6个方面:一是构建终身教育体系,二是改革人才培养模式,三是赋能教学与评测,四是支撑办学与治理,五是创新管理与保障,六是注重隐私与安全(杨宗凯,2023)。而企业、机构、高校形成多级联动,紧密围绕数字技术的创新运用和数据的集成整合,开展基于大数据驱动、人工智能辅助的教育分析与决策,则是支撑好办学与治理这一目标的重要行动。

当前,来自市场的统计数据显示:2022年,我国在线教育、知识付费、在线阅读、智慧教育、教育硬件等数字教育类产品用户规模达到3.14亿人,市场规模高达3620亿元,增幅分别达到了5.36%和12.42%。国内仅教育类APP的数量就超过了15万款。2023年GPT(Generative Pre-Trained Transformer,即生成式预训练Transformer模型)火爆全球,百度的文心一言、抖音的云雀大模型、智谱AI的智谱清言等国内8家大模型产品成为新一代AIGC(AI-Generated Content,即人工智能生成内容)的弄潮者,其中也纳含了多种数字教育应用内容(童莉莉,2024)。

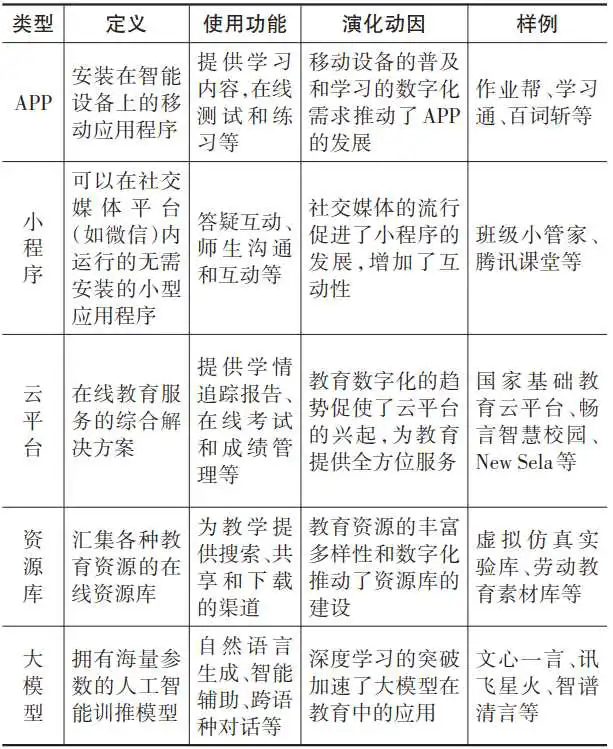

通过运用大数据和人工智能等核心数字技术,智能学伴、AI助教等个性实用的新应用模块正在演化成形态多样的数字教育产品。表1呈现了提供教育服务的APP、小程序、教学云平台、学科资源库、大模型等不同类型的数字教育产品的使用功能、演化动因等,揭示了智能技术对数字教育产品的变革与影响。学科或艺术素养类的教育APP使得时时可学、处处可学成为可能,学习者也能接触到比传统面授课堂更宽广的数字教育资源。班级小管家等小程序的使用,不仅有助于学校等组织较好地应对疫情等公共突发事件对学校正常教学带来的挑战,也有助于师生在实践中提升其数字素养。2023年进入全球公共测试的国际国内大模型,更是让人们体验了其优异的知识表现、流畅的语言交互和跨媒介输出等多项技术红利(何曼,2023)。

表1 数字教育产品的类型

但是AIGC带来的新挑战亦不可回避。首先是数字教育资源的智能化呈现形式带来的审核挑战。传统的静态图文类审核主要靠人工抽检、用户举报+部分关键字校验,越来越多元化的音视频和生成式内容的出现为审核带来了前所未有的挑战。其次是信息扩散的有序性受到冲击。在AIGC技术的使用中,没有明确划分公有数据和专有数据的使用界限,使得数字教育产品中生成式内容的数据合规性、安全性、权属产生问题,数据的有序扩散受阻。第三是认知智能中算法的教育属性不够显著。从计算智能、感知智能再到认知智能的进阶发展来看,AIGC已经为人类社会打开了认知智能的大门。当前的AIGC落地方式主要包括直接使用通用大模型、运用Prompt提示工程、采用低秩自适应(Low-Rank Adaptation,LoRA)方法优化模型等,这些算法设计理念能通过微调参数适应特定场景任务,但对育人规律和学习者认知特点的考量几乎没有体现,算法话语权在商业规则和教育规律之间面临着多主体博弈。

二、AIGC的技术演进与风险产生机理

1.从PGC、UGC到AIGC的技术演进

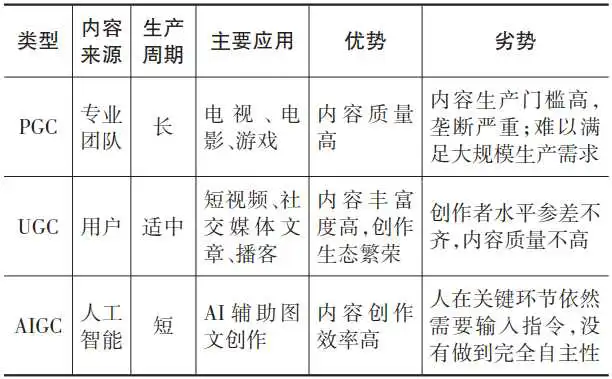

随着Web时代的变迁,互联网上的内容生成模式已经历了从PGC(Professionally-Generated Content,即专业生成内容)到UGC(User-Generated Content,即用户生成内容)再到AIGC的发展历程。这正是技术与社会需求相互作用的产物。相较而言,PGC是由专业创作者创作的内容,注重专业性和深度,因而内容质量较高。Web2.0时期,UGC应运而生,强调用户参与和互动,因而其内容的丰富度较高。Web3.0 时代,AIGC成为创新探索的引领方向,其强调利用自然语言处理和生成技术,融合PGC和UGC的优点,旨在生成创作效率高且质量也高的内容(Qadir,2023)。表2深入剖析了三种不同的内容生成模式的技术和应用特点。

表2 PGC、UGC和AIGC的技术特征和应用对比

2.生成式人工智能的风险产生机理

与AIGC带来的便利相对应的,是教育垂直领域中复杂多变的场景可能引发的应用风险。在已有的公开报道中,我们至少可以看到以下两种风险产生机理:

第一,教育算法缺位引发的认知偏差风险。商业利益裹挟的算法设计可能倾向于仅向用户推荐已经熟悉的领域,而忽视了可能对其有益的多样化内容,从而导致认知茧房效应。同时,算法设计者在内容生成设计时缺乏对学科内前序知识与接续内容足够的参数设置,由此导致学习者难以建立学科知识体系间的正确关联,从而影响其学科综合能力的培养。此外,算法设计在未能充分理解学习者个体差异性(如学科兴趣、学习风格、认知能力等)的前提下,更倾向于向学习者提供通用的教育内容,而无法满足不同学习者的个性化需求,由此亦增加了教育不公平的风险。因此,在纯商业算法导向和教育算法缺位的双重加持下,数字教育资源体现出学科知识呈现片面化和供给不适配的弊端,无法促进学习者的全面发展和个性化发展。因而,在AIGC越来越多地应用于教育领域的过程中,由教育算法缺位引发的认知偏差风险亟需引起学界的高度重视。

第二,技术监管滞后引发的信息无序扩散风险。AIGC更加智能化、实用化所依赖的三大要素是数据、算力、算法。这三类要素都在伴随前沿技术快速迭代:数据标注技术和增强技术、基础算力平台和分布式训练环境、算法模型建立和自动训推技术等。教育数据包括个人属性、家庭情况、学业成绩、心理健康等多方面隐私信息,监管技术的研发滞后可能会引发未成年学生的教育及成长类数据的无序公开、挖掘滥用、隐私泄露等不当情况。因此,加强数据归集、算力统筹、算法开源等平台和基础能力建设,有效抑制形态多样的数字教育产品中文本、图像、语音、视频等生成式内容在复杂网络中的无序扩散风险,亦是当前学界和实践领域的重要关切。

三、基于风险识别矩阵的治理体系设计

AIGC发展所仰赖的三要素(即数据、算力、算法)在教育领域垂直应用的风险可具象化为三类,分别是数字资源中的生成式数据风险、大算力支撑下的信息无序传播风险和商业算法偏离育人目标。同时,数字教育产品的规模化应用亦使得传统线下学习者评价需要向线上线下虚实融合的认知评估方向发展。有鉴于此,笔者将从“数字资源—信息传播—算法设计—认知评估”四个维度来设计风险矩阵,以期为数字教育产品的规模化治理提供框架指导。

1.“数字资源—信息传播—算法设计—认知评估”四维风险矩阵

2021年11月,《中华人民共和国个人信息保护法》正式施行(新华社,2021)。同一时期,国家互联网信息办公室等四部门联合发布《互联网信息服务算法推荐管理规定》,就生成合成类、个性化推送类、排序精选类、检索过滤类、调度决策类等算法技术向用户索取信息的具体要求进行了规范(国家互联网信息办公室等,2021)。2022年5月,教育部办公厅印发《国家智慧教育平台数字教育资源内容审核规范(试行)》,要求数字资源围绕政治性、科学性、适用性和规范性,采用机器审核和人工审核相结合的方式,加强上线审查和更新复查(教育部办公厅,2022)。2023年7月,国家互联网信息办公室、国家发展和改革委员会、教育部、科技部、工业和信息化部、公安部、国家广播总局七部门联合发布《生成式人工智能服务管理暂行办法》,在通用领域和部分垂直领域利用生成式人工智能技术向中华人民共和国境内公众提供生成文本、图片、音频、视频等内容的服务作出规定(国家互联网信息办公室等,2023)。从已出台的政策来看,诸多政策均已涉及对数字资源、信息传播和算法设计的监管约束。在此背景下,教育研究领域亟需针对教育垂直行业中基于数字化学习环境的线上线下融合的适应性认知评估开展理论研究和技术研发。

基于此,本文采用社会定义范式和行为计算范式相结合的设计思路,提出了“数字资源—信息传播—算法设计—认知评估”四维风险矩阵。社会定义范式强调社会中各参与方在定义和塑造数字教育产品过程中的角色和影响,为治理体系提供了社会化的视角。行为计算范式强调将上述角色影响进行量化计算,用精准技术指标提升社会领域治理问题的科学化程度。本研究以社会定义范式指导研究的开发者、使用者、监管者等群体建立交互关系,以行为计算范式指导研究的风险矩阵构建,以此来探求符合教育规律的数字教育产品的治理流程。

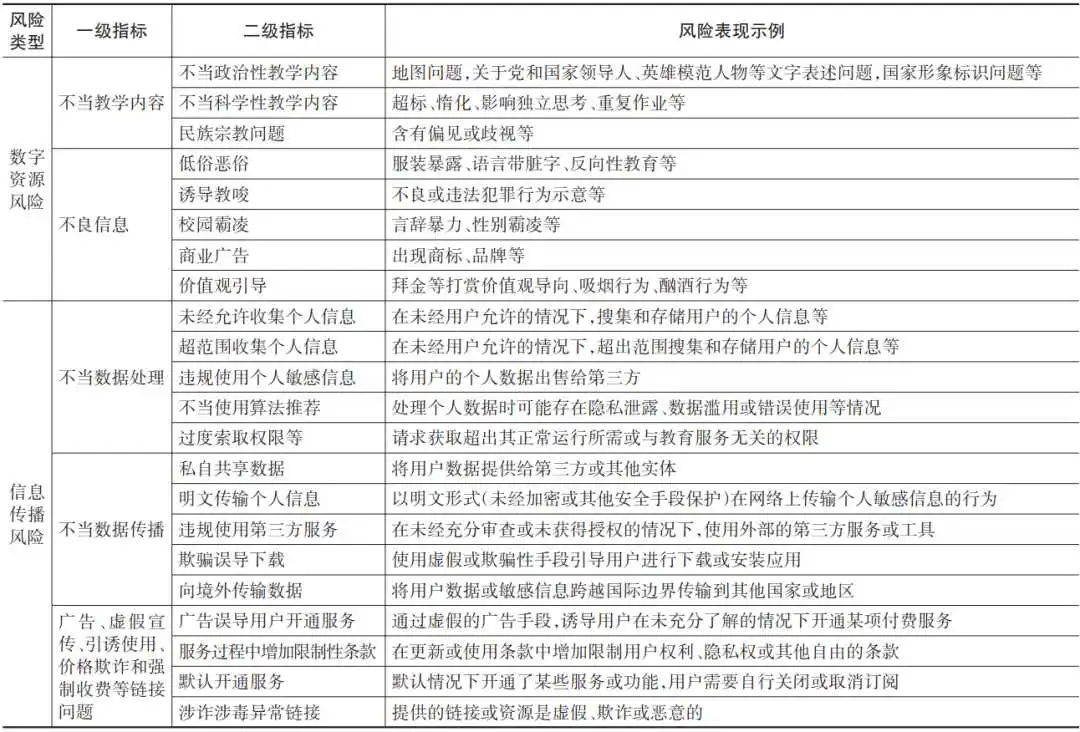

在社会定义范式下,“数字资源—信息传播—算法设计—认知评估”四维风险矩阵阐明了当前数字教育产品存在的四重风险及其内涵。其一,数字资源类风险。此类风险主要是指数字教育产品中的教学资源(如静态图册、动态音视频和生成内容等)存在不符合国家法律法规、教育规范、学科标准等要求的情况,如有害信息、错误信息、重复信息等,其可能对学生的身心健康、价值观、学习效果等造成不良影响。其二,信息传播类风险。这类风险是指数字教育产品中涉及的个人信息传播行为存在泄露、滥用、篡改等安全隐患,学习者基本信息或学情数据可能被不法分子或未授权方滥用于诈骗、虚假宣传、广告等方面(张黎等,2023)。其三,算法设计类风险。该类风险是指数字教育产品中使用的算法或人工智能技术存在不透明、不可解释、歧视倾向等问题,未能体现育人导向,可能会对学生的学习行为、认知发展、个性形成等产生不可控的负面影响,或对教育公平、质量、效率等带来潜在威胁(Fraser et al.,2004)。其四,认知评估类风险。这类风险是指数字教育产品提供的学习方式存在不适合学生年龄段、地域特色、认知特点等情况,可能会对学生的注意力、记忆力、思维力等造成损害,或导致学生出现过度依赖技术产品、缺乏创新等问题(Boninger et al.,2017)。

在行为计算范式下,“数字资源—信息传播—算法设计—认知评估”四维风险矩阵还需从定性概念深化为定量指标。其中一级指标源于前文所述的教育部等部委出台的规范和规定类文件,二级指标源于本文受资助的两个国家级项目的前期循证调研,并以指标对应数据的可采集性为主要筛选原则来构建风险矩阵量化指标。具体的指标构成及风险示例如表3所示。

表3 “数字资源—信息传播—算法设计—认知评估”四维风险矩阵指标描述

2.“监管者—开发者—使用者”协同治理架构

从“数字资源—信息传播—算法设计—认知评估”四维风险矩阵的量化指标中可以看出,使用者端和开发者端面临大量的风险挑战,传统监管手段或单一主体难以保障场景复杂、形式众多的数字教育应用生态的健康良性发展(何伟光,2023)。有鉴于此,本研究提出一种“监管者—开发者—使用者”协同治理架构,旨在由监管者“事前—事中—事后”全周期推动治理进程,开发者参照标准研制新产品或者让已有产品的运维接受常态化测评,使用者根据用户端体验反馈治理需求,并由三方共同推动数字教育产品良性治理生态的构建。

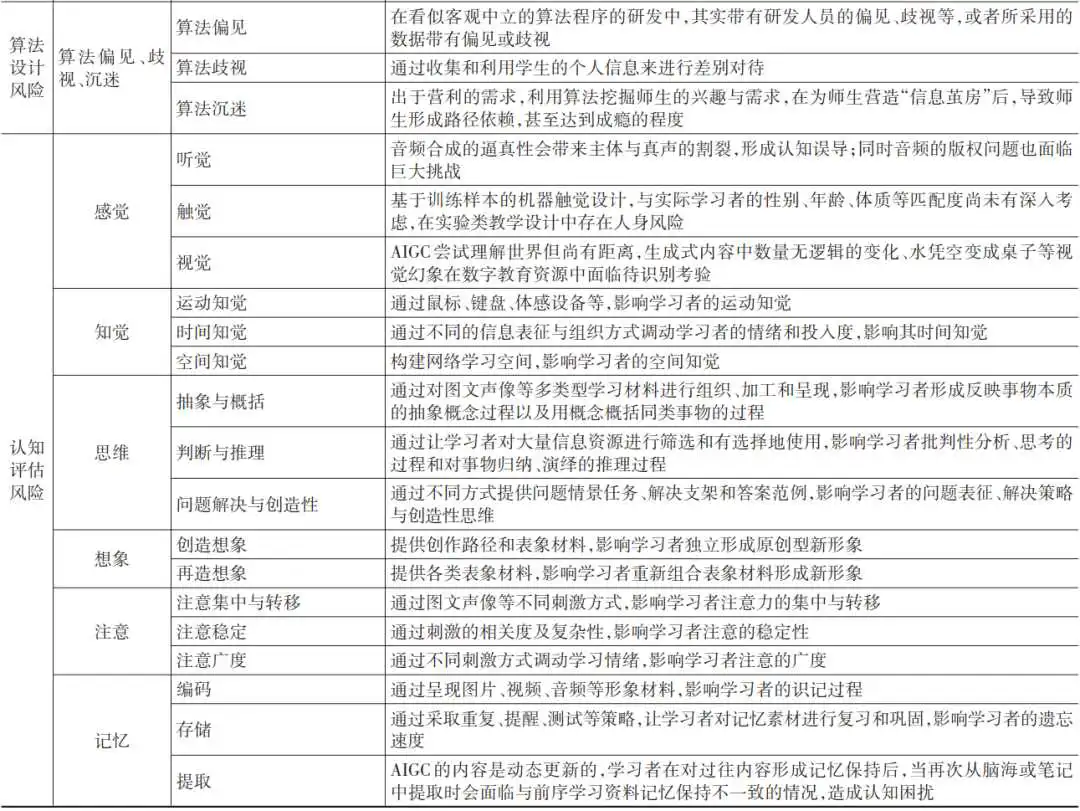

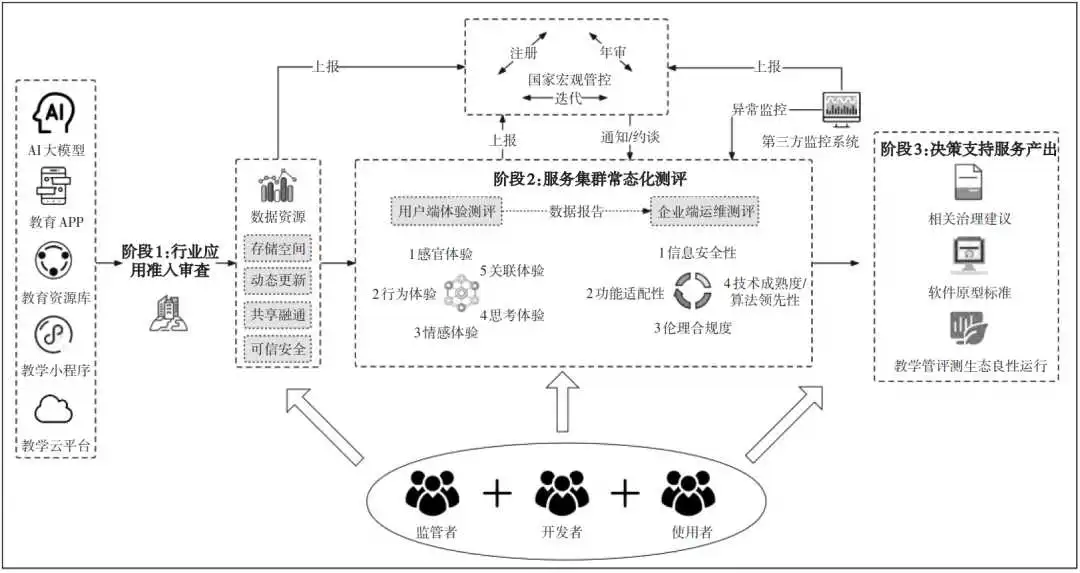

图1为“监管者—开发者—使用者”协同治理架构示意图。该图揭示了监管者、开发者和使用者对数字教育产品进行协同治理需要经历如下三个阶段。

图1 “监管者—开发者—使用者”协同治理架构示意图

阶段一:行业应用准入审查。以监管者为主体的方式实施,包括对小程序、Web端、APP等的存储空间、动态更新、共享融通、可信安全等进行全面审查,以期实现对包括生成式内容在内的多源数据的结构化表示,让算法设计更契合教育规律,并降低软件跨域应用的不确定性风险。

阶段二:服务集群常态化测评。以监管者授权的第三方机构检测、开发者自查和使用者监督相结合的形式实施。主要从用户端体验测评和企业端运维测评两方面开展,旨在形成“人员审查+社群举报+技术自查”的常态化监测体系,并能按照风险等级启动精准的治理策略。用户端体验测评主要涉及感官体验、行为体验、情感体验、思考体验和关联体验等;企业端运维测评主要包括信息安全性、功能适配性、伦理合规度、技术成熟度/算法领先性等方面,旨在促进数字教育产品的治理精准性,提高教育软件应用行业的运维成熟度。

阶段三:决策支持服务产出。以监管者采信、开发者遵约、使用者受益为目标形式。该阶段从技术产出看,就是要形成数字教育应用的数据采集、调用、迭代标准;从咨政角度看,就是要形成基于科学监测数据的治理建议。

在教育数字化转型时期,对数字教育产品的治理已经从传统单一的自上而下的管理,升级为社会多元化需求、技术快速驱动、监管全周期关注的治理新阶段。多主体协同是适应这一新阶段的有效路径。通过监管者的“事前—事中—事后”全周期关注、开发者按标准研制新产品、使用者的“感官—行为—情感—思考—关联”等不同认知阶段的差异化体验,可以实现对以AIGC为代表的新技术带来的技术红利加快释放、隐患风险可控的治理目标。

四、风险甄别与治理实证案例

随着生成式人工智能技术的迅速发展和普及,笔者团队在对“不良内容、重点账号、评论治理”等传统场景进行重点治理的基础上,与某企业联合在生成式人工智能场景下不断提升算法的识别能力,围绕未成年人网络环境专项治理的重点领域,根据治理要求不断细化审核规则,搭建语音语义识别算法模型和皮肤裸露面积识别模型两个专项审核队列,通过“风险矩阵甄别+治理策略跟进”的模式,全面压缩有害信息隐形变异的生存空间,遏制数字教育产品中数字资源和算法设计中可能侵害未成年人权益的违法行为(王佑镁等,2023)。其中皮肤裸露面积识别模型的实例内容如下。

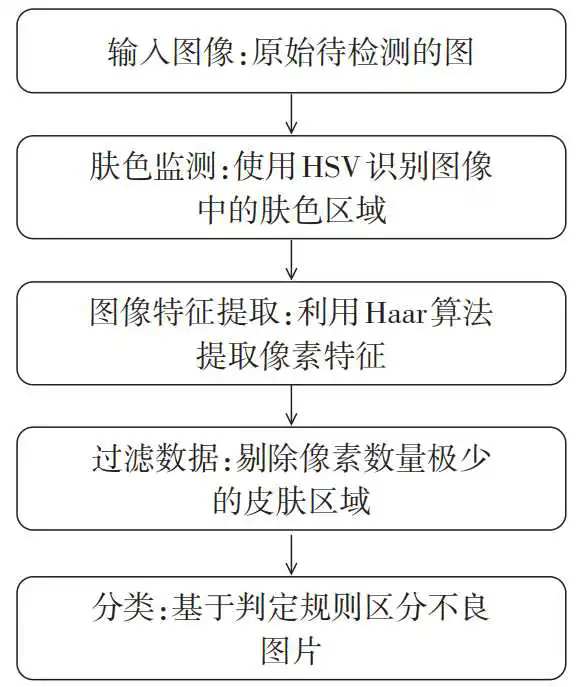

该实例的治理目标是对数字资源中的静态图片、动态音视频、生成式内容中的人物皮肤裸露情况进行自动识别,若检测到存在违规内容,则立即给出警示。该实例的风险甄别标准是根据颜色(肤色)找出图片中皮肤的区域,然后通过条件判断是否为违规内容。关键步骤如下:第一,遍历每个像素,检测像素颜色是否为肤色。第二,将相邻的肤色像素通过池化算法归为一个皮肤区域,得到若干个皮肤区域。第三,剔除像素数量极少的皮肤区域。同时,我们将非色情图片的判定规则定义如下(满足任意一个判定即为真):一是皮肤区域的个数小于 3 个,二是皮肤区域的像素与图像所有像素的比值小于 15%,三是最大皮肤区域小于总皮肤面积的40%,四是皮肤区域数量超过50个。规则可以尝试更改,直到程序效果满意为止。基于肤色监测的皮肤裸露面积识别流程如图2所示。

图2 基于肤色监测的皮肤裸露面积识别流程

该识别过程在肤色监测和图像特征提取两个环节用到两个关键算法:HSV算法和Haar算法。HSV是一种根据人类对颜色的直观感知创建的颜色空间(李明东,2018)。其中,H表示色调(Hue),用角度来衡量,范围为0°~360°,从红色(指向0°)开始逆时针方向变化,当转向120°时显示为绿色,当转向240°时显示为蓝色;S表示饱和度(Saturation),用颜色的纯度来衡量,取值范围是0.0~1.0,表示颜色从暗淡到鲜艳;V表示亮度(Value),其取值范围亦是0.0~1.0,表示从黑色到明亮。随着数字教育资源中多彩图文和音视频的监测需求迅速增长,能更好贴合人眼解释图像过程的开源环境如OPENCV也开始大量使用这一算法,其对应的取值范围分别是H=[0,179],S=[0,255],V=[0,255]。Haar分类器是用于目标检测技术的一种基于特征的机器学习算法(Papageorgiou et al.,1998)。该算法通过对图像中的不同特征进行组合,来判断图片中是否存在目标物体。其核心思想是提取人脸特征,使用积分图对特征进行快速计算,挑选出少量关键特征,送入由强分类器组成的级联分类器进行迭代训练。

在皮肤裸露面积识别的具体案例中,监管者、开发者与使用者的协同作用印证了紧密的技术治理体系。首先,监管者制定不良皮肤裸露内容甄别标准和判定规则,确保对违规内容的判断条件等规则能够转化为开发者可以遵循的技术指南。其次,开发者利用图像处理技术,如上文提到的HSV算法和Haar算法等,来实现对肤色的精确识别和皮肤区域的有效聚合。通过池化算法,开发者能够将相邻的肤色像素归类,形成一个个皮肤区域,并根据预设的条件判断规则,如皮肤区域的数量、像素占比、最大区域面积比例等,来确定内容是否违规。最后,使用者依靠算法模型来监控教育应用软件中的内容,确保没有违规的图片或视频出现。一旦发现潜在的违规内容,使用者可以立即报告给监管者或通过软件内的举报机制进行反馈。

该案例仅是AIGC风险识别与治理中图片生成内容的实证过程,运用了池化算法的技术原理,通过不同的数据增幅来调整池化个数,从而识别一张图片中皮肤裸露的比例,并据此判断涉黄风险概率。未来,在AIGC的图片生成内容治理领域,可以从如下方面进行努力:一是研发更准确的图像分割技术,不断提高皮肤裸露面积识别的准确性,既要准确标识出皮肤区域,又要将其与其他区域区分开来。二是研发更强大的隐私保护技术,如模糊化、去标识化等技术,以确保用户隐私数据的安全。

五、研究总结与展望

数字教育是数字中国的重要组成部分,更是建设教育强国的重要支撑力量。数字教育产品形态日新月异,数量规模不断攀升,且虚实融合环境中的学习者持续增多,这些复杂的在线学习场景对风险监管能力提出了更新且更高的要求。当然,数智技术的发展也为治理能力提升带来了更多的可能性,如以生成性要素挖掘为核心的语义解析技术将促进内容监管颗粒度更加精准,而污点传播和图卷积技术的发展将会促进数字资源传播溯源度不断提高(孟令宇,2022)。

本研究从数字教育产品的类型分析切入,深入剖析了从PGC、UGC到AIGC的演进过程,提出了“数字资源—信息传播—算法设计—认知评估”四维度风险矩阵,并从“监管者—开发者—使用者”协同的视角探讨了数字教育产品的治理体系,最后以算法识别模型为例,证实了风险甄别的过程和综合治理能力的提升。展望未来,该领域后续可从以下两个方面发力:

第一,文本挖掘及跨时空学习特征表示技术研究。即运用基于过程标注和结果标注的多维画像构建技术,结合图文、音视频等多模态数据,实现对未来特定用户节点的学习状态或群体学习状态的感知及预测。通过分析学生的在线学习行为轨迹和学情画像,还可汇聚认知发展动态评估数据,从而为数字教育应用对学生认知发展影响的检测提供环境和技术支持。

第二,构建AIGC内容的风险量化治理规则库。生成式人工智能技术虽然迎来新一波发展热潮,但是其量化治理规则库却不够充实。AIGC在为用户带来智能化、趣味性体验的同时,也暴露出了常识性错误、不当文化倾向等弊端。在已有谐音词/词库、皮肤曝光面积计算模型等数字资源的量化治理基础上,持续研究构建针对AIGC的“信息传播—算法设计—认知评估”量化治理规则库十分必要,包括研究Hook分析、污点传播、认知发展智能测评等,这些对缓解数字教育产品应用过程中跨域监测难、溯源定位慢、闭环治理松等问题具有重要的实用价值。

参考文献:

[1]国家互联网信息办公室,中华人民共和国工业和信息化部,中华人民共和国公安部等(2021).互联网信息服务算法推荐管理规定[EB/OL].[2024-01-19].http://www.cac.gov.cn/2022-01/04/c_1642894606364259.htm.

[2]国家互联网信息办公室,中华人民共和国国家发展和改革委员会,中华人民共和国教育部等(2023).生成式人工智能服务管理暂行办法[EB/OL].[2024-01-19].https://www.gov.cn/zhengce/zhengceku/202307/content_6891752.htm.

[3]何曼(2023).AIGC更能满足高质量教育体系的新需求——教育部教育信息化战略研究基地(北京)副主任童莉莉专访[EB/OL].[2024-01-19].https://www.sohu.com/a/_.

[4]何伟光(2023).走向解放:人工智能教育应用本质的哲学沉思[J].中国远程教育,43(7):11-20.

[5]教育部办公厅(2022).教育部办公厅关于印发《国家智慧教育平台数字教育资源内容审核规范(试行)》的通知[EB/OL].[2024-01-19].http://www.moe.gov.cn/srcsite/A16/s3342/202211/t20221108_979699.html?eqid=e280d5c40009dfaa000000056437a05b.

[6]李明东(2018).基于HSV颜色空间肤色检测算法的动态手势识别研究[J].鄂州大学学报,25(5):107-109.

[7]孟令宇(2022).从算法偏见到算法歧视:算法歧视的责任问题探究[J].东北大学学报(社会科学版),24(1):1-9.

[8]童莉莉(2024).数字教育应用监管如何“向善”而行[N].中国教育报.2024-01-08(04).

[9]王佑镁,王旦,王海洁等(2023).算法公平:教育人工智能算法偏见的逻辑与治理[J].开放教育研究,29(5):37-46.

[10]新华社(2021).中华人民共和国个人信息保护法[EB/OL].[2024-01-19].https://www.gov.cn/xinwen/2021-08/20/content_5632486.htm.

[11]杨宗凯(2023).数字教育的内涵、发展目标与路径[N].光明日报,2023-03-14(015).

[12] 张黎,周霖,赵磊磊(2023).生成式人工智能教育应用风险及其规避——基于教育主体性视角[J].开放教育研究,29(5):47-53.

[13]Boninger, F., Molnar, A., & Murray, K. (2017). Asleep at the Switch: Schoolhouse Commercialism, Student Privacy, and the Failure of Policymaking[EB/OL].[2023-10-25]. https://nepc.colorado.edu/sites/default/files/publications/RB%20Trends%_2.pdf.

[14]Fraser, M. W., Kirby, L. D., & Smokowski, P. R. (2004). Risk and Resilience in Childhood[M]// Fraser, M. W. (Ed.). Risk and Resilience in Childhood: An Ecological Perspective. Washington, DC: NASW Press:13-66.

[15]Papageorgiou, C. P., Oren, M., & Poggio, T. (1998). A General Framework for Object Detection[C]// Proceedings of the Sixth International Conference on Computer Vision, Bombay, India:555-562.

[16]Qadir, J. (2023). Engineering Education in the Era of ChatGPT: Promise and Pitfalls of Generative AI for Education[C]// Proceedings of the 2023 IEEE Global Engineering Education Conference (EDUCON), Kuwait, Kuwait:1-9.

来源 | 现代远程教育研究

往期回顾

为您提供研究院的最新资讯与科研动态。

研究院广纳贤才,加入我们请发简历至邮箱:

版权声明:

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若内容造成侵权、违法违规、事实不符,请将相关资料发送至xkadmin@xkablog.com进行投诉反馈,一经查实,立即处理!

转载请注明出处,原文链接:https://www.xkablog.com/bcyy/18384.html